-

데이터 변경이력

데이터 변경이력 버전 일자 변경내용 비고 1.1 2023-12-08 데이터 최종 개방 1.0 2023-06-28 데이터 개방(Beta Version) 데이터 히스토리

데이터 히스토리 일자 변경내용 비고 2023-12-27 산출물 전체 공개 소개

비정형 환경에서 로봇이 가려진 목표물을 지능적으로 조작할 수 있도록 가림 관계 정보에 대한 이미지 구축 데이터 제공

구축목적

가려진 물체 인식을 위한 대규모 데이터 구축 표준화된 로봇 비전 벤치마크 제공

-

메타데이터 구조표 데이터 영역 로보틱스 데이터 유형 이미지 데이터 형식 PNG, OBJ, PCD 데이터 출처 직접 촬영 및 수집 라벨링 유형 물체 6D 자세(이미지), 사람 손 3D 키포인트(이미지) 라벨링 형식 JSON 데이터 활용 서비스 - 데이터 구축년도/

데이터 구축량2022년/물체 3D 스캔 데이터 200종 / 다수 물체 가림 데이터 154,600세트 / 로봇-물체 파지 데이터 112,359세트 / 사람-물체 파지 데이터 126,000세트 = 총합계 393,159세트 -

데이터 구축 규모

데이터 구축 규모 데이터 구분 데이터 수량(세트) 물체3D스캔데이터 200 다수물체가림데이터 가상 100,000 실제 54,600 로봇-물체파지데이터 가상 46,000 실제 66,359 사람-물체파지데이터 126,000

데이터 분포

- 물체 클래스 구성: 물체 3D 스캔 데이터데이터 분포- 물체 클래스 구성: 물체 3D 스캔 데이터 구분 빈도 비율 가정 100 50% 산업 50 25% 물류 50 25% 합계 200 100.00% - 가상-실환경 데이터

데이터 분포- 가상-실환경 데이터<다수 물체 가림 데이터> 구분 빈도 비율 가상 100,000 65% 실제 54,600 35% 합계 154,600 100.00% <다수 물체 가림 데이터>

데이터 분포- 가상-실환경 데이터<로봇-물체 파지 데이터> 구분 빈도 비율 가상 46,000 40% 실제 66,359 60% 합계 112,359 100.00% <로봇-물체 파지 데이터>

-

-

AI 모델 상세 설명서 다운로드

AI 모델 상세 설명서 다운로드 AI 모델 다운로드모델학습

모델학습 항목명 학습 대상 모델 측정 지표 인스턴스 분할 다수 물체 가림 데이터 Mask R-CNN mAP 로봇-물체 파지 데이터 아모달 인스턴스 분할 다수 물체 가림 데이터 UOAIS-Net mAPA 로봇-물체 파지 데이터 물체의 6D 자세 예측 다수 물체 가림 데이터 TemplatePose RecallVSD 로봇 서비스 활용 시나리오

1. 로봇의 가려진 물체 인식 및 파지 순서 계획 수립

- 로봇이 가려진 물체를 파지하기 위한 물체 인식 및 파지 순서 계획에 활용

- 물체의 가시 영역, 가려진 영역, 가려짐 여부를 인식하고, 목표 물체가 가려지지 않을 때까지 목표 물체를 가리고 있는 인접 물체를 파지함

- GIST AILAB이 보유하고 있는 기술로 본 과제의 데이터셋을 이용해 추가 학습해 가려진 영역 추론 성능을 향상시키고 다양한 비정형 환경에서의 물체 파지에 활용

2. 다양한 비정형 환경에서의 물체 인식 및 파지

- 본 과제를 통해 구축된 데이터셋은 가정, 물류, 산업 현장에서의 책상, 선반, 상자 등의 다양한 환경 및 배치의 데이터셋을 포함하므로, 해당 데이터셋을 이용해 학습한 딥러닝 모델을 활용하면 특정 환경에 맞게 데이터셋을 별도 구축할 필요없이 다양한 비정형 환경에서 물체의 가려진 영역 및 가시 영역을 손쉽게 인식 가능 -

데이터 성능 점수

측정값 (%)기준값 (%)데이터 성능 지표

데이터 성능 지표 번호 측정항목 AI TASK 학습모델 지표명 기준값 점수 측정값 점수 1 가시 영역 객체 검출 성능 Image Classification Mask R-CNN mAP 40 % 52.57 % 2 아모달 영역 객체 검출 성능 Object Detection UOAIS-Net mAP 30 % 52.09 % 3 물체의 6D 자세 예측 성능 Prediction TemplatePose Recall(VSD) 30 % 61.78 %

※ 데이터 성능 지표가 여러 개일 경우 각 항목을 클릭하면 해당 지표의 값이 그래프에 표기됩니다.

※ AI모델 평가 지표에 따라 측정값의 범위, 판단 기준이 달라질 수 있습니다. (ex. 오류율의 경우, 낮을수록 좋은 성능을 내는 것으로 평가됩니다)

-

설명서 및 활용가이드 다운로드

데이터 설명서 다운로드 구축활용가이드 다운로드데이터 요약

- 로봇이 가려져 있는 목표물을 지능적으로 조작하기 위하여 사물의 영역, 자세(Pose), 겹쳐진 관계, 가려진 영역 등을 생성 및 추론하는 데이터클래스 분류

- 다양한 환경에 적용 가능한 200개의 물체 선정

- Category : 가정용 100개, 물류용 50개, 산업용 50개데이터셋 예시

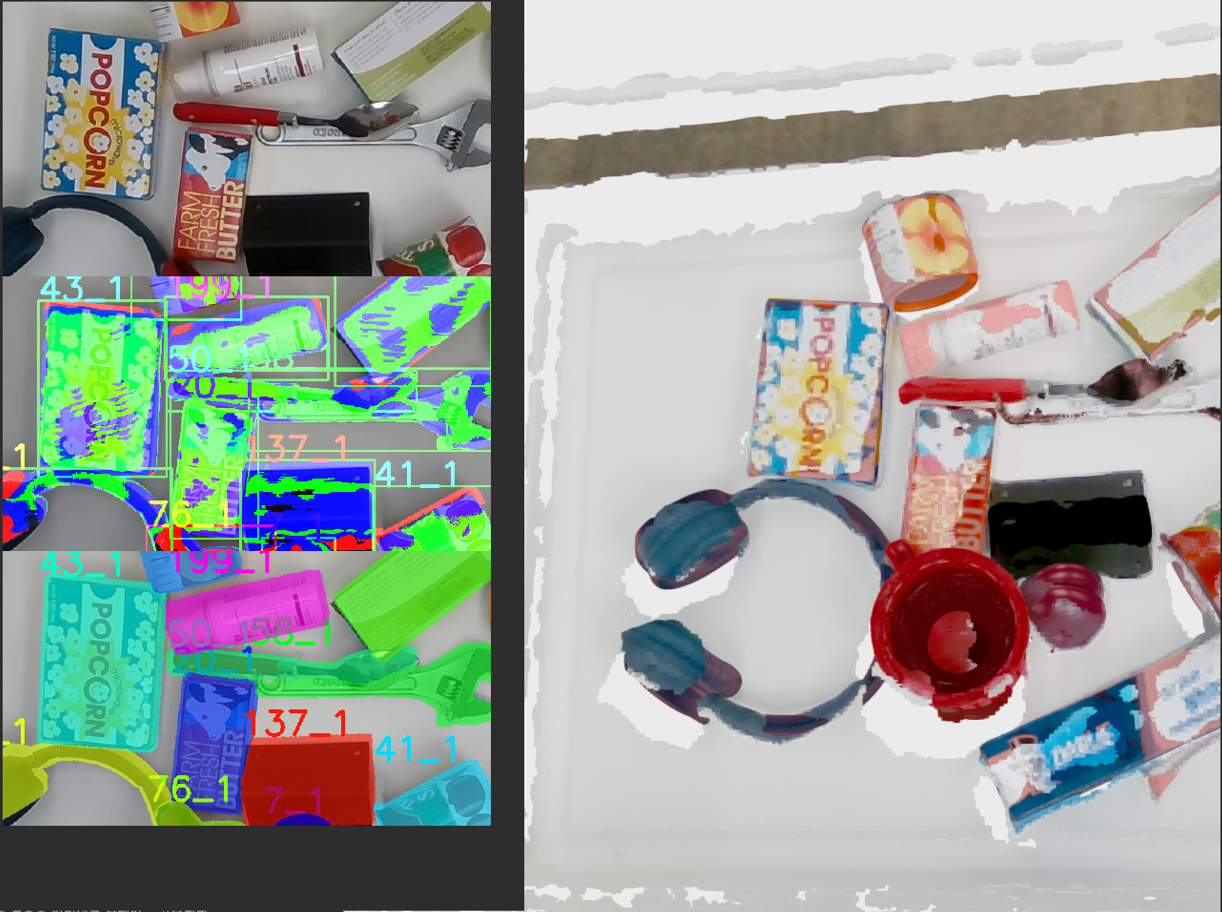

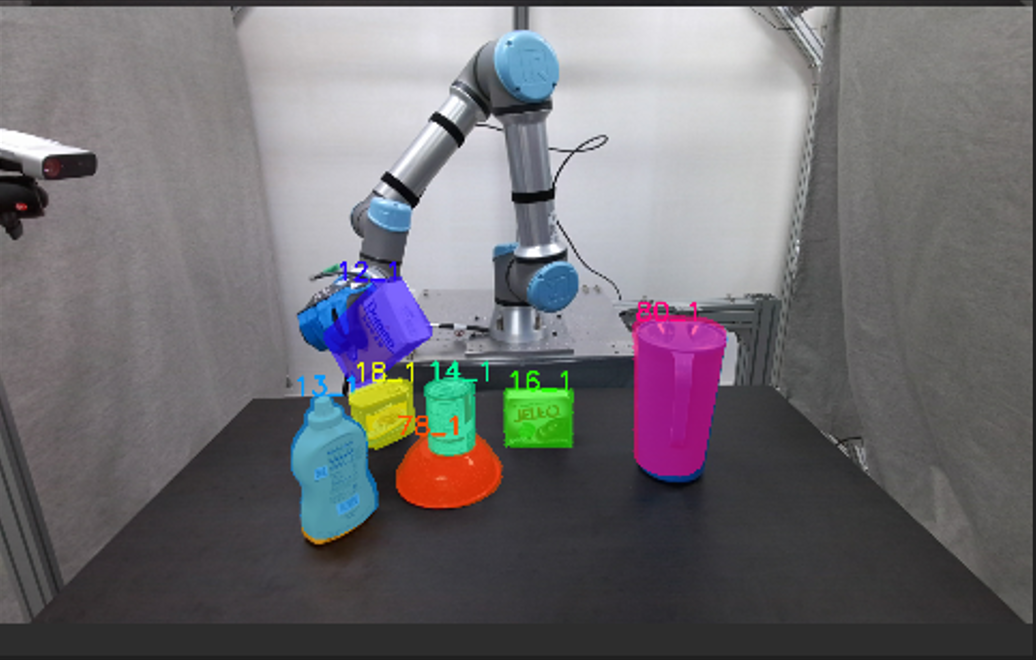

데이터셋 예시 데이터명 데이터 1 데이터 2 데이터 3 데이터 4 (추가) 물체 3D 스캔 데이터 다수 물체 가림 데이터 로봇-물체 파지 데이터 사람-물체 파지 데이터 예시

이미지 설명 물체별 3D 스캐닝 모델 구축을 위해 단일 물체를 촬영한 이미지 데이터 및 카메라 상태 데이터 다수의 물체가 서로 가려진 환경을 촬영한 이미지 및 카메라 상태 데이터 로봇이 물체를 파지한 환경을 촬영한 이미지 및 카메라/로봇 상태 데이터 사람이 물체를 파지한 환경을 촬영한 이미지 및 카메라 상태 데이터 JSON 형식

- 다수 물체 가림 데이터[데이터 2: 다수 물체 가림 데이터] JSON 예시

{

"scene_info" : {

"object_set" : "ycb_all",

"scene_id" : 39,

"image_id": 1,

"environment": "bin1",

"background": "red_wall",

"split": "train"

},"camera_info" : {

"cam_R_w2c": [-0.04, 0.87, -0.3, 0.76, 0.33, 0.54, 0.64, -0.34, -0.68],

"cam_t_w2c": [-94.8, 189.90, 23],

"cam_K": [322.2, 0.0, 320.8, 0.0, 312.4, 178.8, 0.0, 0.0, 1],

"depth_scale": 10,

"resolution": [1080, 1280],

"camera_type": "azure_kinect“

},"annotation": [

{

"object_id": 78,

"instance_id": 1,

"cam_R_m2c": [0.42, 0.72, -0.55, -0.02, 0.62, 0.78, 0.91, -0.32, 0.28],

"cam_t_m2c": [0.33, 0.45, 0.11],

"visible_mask" : Ga5F456...,

"invisible_mask" : C4s63523...,

"amodal_mask" : 3465D342...,

"occlusion_order" : [{order: “1=2”, overlap: False} , { ..}, .. ],

"depth_order" : [{order: “1<2”, overlap: True}, {...}, ... ]

},

{

"object_id": 7,

.....},

....

]

}

어노테이션 포맷

- 물체 3D 스캔 데이터어노테이션 포맷- 물체 3D 스캔 데이터 [데이터 1: 물체 3D 스캔 데이터] 라벨링 데이터 구조 번호 항목 타입 필수 작성예시 한글명 영문명 여부 1 물체 종류 object_type Object Y - 1.1 슈퍼 클래스 super_class Int Y 3 1.2 물체 분류 sub_class Int Y 1 1.3 시멘틱 클래스 semantic_class Int Y 2 1.4 물체 아이디 object_id Int Y 8 - 다수 물체 가림 데이터

어노테이션 포맷- 다수 물체 가림 데이터 [데이터 2: 다수 물체 가림 데이터] 라벨링 데이터 구조 번호 항목 타입 필수 작성예시 한글명 영문명 여부 1 이미지 정보 scene_info Dictionary Y - 1.1 물체 세트 정보 object_set String Y "ycb_all" 1.2 공간 ID scene_id Int Y 39 1.3 이미지 ID image_id Int Y 1 1.4 환경 environment String N "bin1" 1.5 배경 background String N "red_wall" 1.6 데이터 구분 split String N "train" 2 카메라 정보 camera_info Dictionary Y - 2.1 카메라 자세 (회전 값) cam_R_w2c array Y [-0.04, 0.87, -0.3, 0.76, 0.33, 0.54, 0.64, -0.34, -0.68] 2.2 카메라 자세 (위치 값) cam_t_w2c array Y [-94.8, 189.90, 23] 2.3 카메라 내부 파라미터 cam_K array Y [322.2, 0.0, 320.8, 0.0, 312.4, 178.8, 0.0, 0.0, 1] 2.4 깊이 정보 스케일 depth_scale float Y 10 2.5 카메라 해상도 resolution array Y [1080, 1280] 2.6 카메라 종류 camera_type String Y “azure_kinect” 3 라벨링 정보 annotation List of Dictionary Y - 3.1 물체 아이디 object_id Int Y 8 3.2 인스턴스 아이디 instance_id Int Y 1 3.3 물체 자세 (회전 값) cam_R_m2c Array Y [0.42, 0.72, -0.55, -0.02, 0.62, 0.78, 0.91, -0.32, 0.28] 3.4 물체 자세 (위치 값) cam_t_m2c Array Y [0.33, 0.45, 0.11] 3.5 가시 마스크 visible_mask RLE Y Ga5F456... 3.6 비가시 마스크 invisible_mask RLE Y C4s63523... 3.7 아모달 마스크 amodal_mask RLE Y 3465D342... 3.8 가림 순서 occlusion_order List of Dictionary Y {order: “1<2”, overlap: False} 3.9 깊이 순서 depth_order List of Dictionary Y {order: “1<2”, overlap: False} - 로봇-물체 파지 데이터

어노테이션 포맷- 로봇-물체 파지 데이터 [데이터 3: 로봇-물체 데이터] 라벨링 데이터 구조 번호 항목 타입 필수 작성예시 한글명 영문명 여부 1 이미지 정보 scene_info Dictionary Y - 1.1 물체 세트 정보 object_set String Y "ycb_all" 1.2 공간 ID scene_id Int Y 39 1.3 이미지 ID image_id Int Y 1 1.4 환경 environment String N "bin1" 1.5 배경 background String N "red_wall" 1.6 데이터 구분 split String N "train" 2 카메라 정보 camera_info Dictionary Y - 2.1 카메라 자세 (회전 값) cam_R_w2c array Y [-0.04, 0.87, -0.3, 0.76, 0.33, 0.54, 0.64, -0.34, -0.68] 2.2 카메라 자세 (위치 값) cam_t_w2c array Y [-94.8, 189.90, 23] 2.3 카메라 내부 파라미터 cam_K array Y [322.2, 0.0, 320.8, 0.0, 312.4, 178.8, 0.0, 0.0, 1] 2.4 깊이 정보 스케일 depth_scale float Y 10 2.5 카메라 해상도 resolution array Y [1080, 1280] 2.6 카메라 종류 camera_type String Y “azure_kinect” 2.7 초 secs int Y 10 2.8 나노초 nsecs int Y 6489410 3 라벨링 정보 annotation List of Dictionary Y - 3.1 물체 아이디 object_id Int Y 8 3.2 인스턴스 아이디 instance_id Int Y 1 3.3 물체 자세 (회전 값) cam_R_m2c Array Y [0.42, 0.72, -0.55, -0.02, 0.62, 0.78, 0.91, -0.32, 0.28] 3.4 물체 자세 (위치 값) cam_t_m2c Array Y [0.33, 0.45, 0.11] 3.5 가시 마스크 visible_mask RLE Y Ga5F456... 3.6 비가시 마스크 invisible_mask RLE Y C4s63523... 3.7 아모달 마스크 amodal_mask RLE Y 3465D342... 3.8 가림 순서 occlusion_order List of Dictionary Y {order: “1>2”, overlap: True} 3.9 깊이 순서 depth_order List of Dictionary Y {order: “1>2”, overlap: True} 4 로봇 정보 robot_info Dictionary Y - 4.1 로봇 종류 robot_type String Y "ur5e" 4.2 로봇 joint 이름 robot_joint_name array Y [“base”, “elbow”, “hand_left_finger”, “hand_right_finger”, “wrist”] 4.3 로봇 joint 위치 robot_joint_position Array of Array Y [[202.36, -417.72, 801.72, -173.64, 189.39], ...] 4.4 로봇 joint 속도 robot_joint_velocity Array of Array Y [[93604.33, -107.12, 293.71, 24.74, 107.80], ...] 4.5 그리퍼 종류 gripper_type String Y “robotiq_2f_85” 4.6 그리퍼 joint 이름 gripper_joint_ array Y [“left_finger”, “right_finger”] name 4.7 그리퍼 joint 위치 gripper_joint_ Array of Array Y [[0.4828193832599119], ... ] position 4.8 유저 커맨드 종류 command_type string N "spacenav" 4.9 유저 커맨드 값 command_value Array of Array N [ [0.0, 0.0,0.0,-0.19609375,-0.02734375,0.0], [... ], ...] 4.1 로봇 가시 마스크 robot_visible_mask RLE N 412dadsl.. 4.11 로봇 아모달 마스크 robot_amodal_mask RLE N dfnhk4123l... 4.12 그리퍼 가시 마스크 gripper_visible_mask RLE N 412dadsl.. 4.13 그리퍼 아모달 마스크 gripper_amodal_mask RLE N dfnhk4123l... - 사람-물체 파지 데이터

어노테이션 포맷- 사람-물체 파지 데이터 [데이터 4: 사람-물체 데이터] 라벨링 데이터 구조 번호 항목 타입 필수 작성예시 한글명 영문명 여부 1 이미지 정보 scene_info Dictionary Y - 1.1 카메라 ID camera_id Int Y 1 1.2 피실험자 ID subject_id String Y "subject_1" 1.3 이미지 ID image_id Int Y 1 1.4 데이터 구분 split String N "train" 2 카메라 정보 camera_info Dictionary Y - 2.1 카메라 자세 (회전 값) cam_R_w2c array Y [-0.04, 0.87, -0.3, 0.76, 0.33, 0.54, 0.64, -0.34, -0.68] 2.2 카메라 자세 (위치 값) cam_t_w2c array Y [-94.8, 189.90, 23] 2.3 카메라 내부 파라미터 cam_K array Y [322.2, 0.0, 320.8, 0.0, 312.4, 178.8, 0.0, 0.0, 1] 2.4 깊이 정보 스케일 depth_scale float Y 10 2.5 카메라 해상도 resolution array Y [1080, 1280] 3 손 자세 정보 hand_pose_info Dictionary of Dictionary Y - 3.1 오른손 정보 right Dictionary N 3.1.1 손 3D 자세 hand_position Array of Array Y [[0.42, 0.72, -0.55], [-0.02, 0.62, 0.78], [0.91, -0.32, 0.28], ... [0.33, 0.45, 0.11]] 3.1.2 손 모델 모양 정보 mano_shape Array Y [0.42, 0.72, -0.55, 0.02, 0.62, 0.78, 0.91, -0.32, 0.28, 0.11] 3.1.3 손 모델 자세 정보 mano_pose Array Y [0.82, 0.42, -0.51, -0.12, 0.22, 0.18, 0.94, -0.62, 0.23, ...0.35, 0.49, 0.81] 3.2 왼손 정보 left Dictionary N 3.2.1 손 3D 자세 hand_position Array of Array Y [[0.42, 0.72, -0.55], [-0.02, 0.62, 0.78], [0.91, -0.32, 0.28], ... [0.33, 0.45, 0.11]] 3.2.2 손 모델 모양 정보 mano_shape Array Y [0.42, 0.72, -0.55, 0.02, 0.62, 0.78, 0.91, -0.32, 0.28, 0.11] 3.2.3 손 모델 자세 정보 mano_pose Array Y [0.82, 0.42, -0.51, -0.12, 0.22, 0.18, 0.94, -0.62, 0.23, ...0.35, 0.49, 0.81] 4 물체 6D 자세 정보 object_6d_pose_info List of Dictionary Y - 4.1 물체 아이디 object_id Int Y 8 4.2 인스턴스 아이디 instance_id Int Y 1 4.3 물체 자세 (회전 값) cam_R_m2c Array Y [0.42, 0.72, -0.55, -0.02, 0.62, 0.78, 0.91, -0.32, 0.28] 4.4 물체 자세 (위치 값) cam_t_m2c Array Y [0.33, 0.45, 0.11] 4.5 가시 마스크 visible_mask RLE Y Ga5F456... 4.6 비가시 마스크 invisible_mask RLE Y C4s63523... 4.7 아모달 마스크 amodal_mask RLE Y 3465D342... 실제 예시

- 다수-물체 가림 데이터[데이터 2: 다수 물체 가림 데이터] JSON 실제 예시

[데이터 2: 다수 물체 가림 데이터] JSON 실제 예시

{ "scene_info": {

"object_set": "house_all",

"scene_id": 633,

"image_id": 1,

"environment": "table2",

"background": "white_wall",

"split": "train"

},

"camera_info": {

"cam_R_w2c": [

-0.022288431663474356,

...

-0.7033833220485411

],

"cam_t_w2c": [

-443.46171992191444,

-10.259095537292605,

802.3987620362495

],

"cam_K": [

1376.8229243954224,

...

1.0

],

"depth_scale": 1.0,

"resolution": [

1080,

1920

],

"camera_type": "realsense_d415"

},

"annotation": [

{

"object_id": 13,

"instance_id": 1,

"cam_R_m2c": [

-0.08818495473925085,

...

0.05790029915091534

],

"cam_t_m2c": [

28.607670199004378,

104.93424975776199,

831.9419581392178

],

"visible_mask": "TZgl02aQ1...",

"invisible_mask": "cXfl06YQ1...",

"amodal_mask": "cXfl06YQ1=...",

"occlusion_order": [

{

"order": "0<6"

}

],

"depth_order": [

{

"order": "0<1",

"overlap": "True"

},

...

{

"order": "9<0",

"overlap": "True"

}

]

},

...

]

}

-

데이터셋 구축 담당자

수행기관(주관) : ㈜미디어그룹사람과숲

수행기관(주관) 책임자명 전화번호 대표이메일 담당업무 김지빈 02-830-8583 kjb@humanf.co.kr AI 학습용 데이터 설계/구축 데이터 가공, 품질관리 수행기관(참여)

수행기관(참여) 기관명 담당업무 광주과학기술원 AI 학습용 데이터 설계, 수집, 정제 / AI 학습 모델 개발 서울시스템(주) AI 학습용 데이터 품질관리 한알음정보주식회사 AI 학습용 데이터 가공 데이터 관련 문의처

데이터 관련 문의처 담당자명 전화번호 이메일 김지빈 02-830-8583 kjb@humanf.co.kr

-

인터넷과 물리적으로 분리된 온라인·오프라인 공간으로 의료 데이터를 포함하여 보안 조치가 요구되는 데이터를 다운로드 없이 접근하고 분석 가능

* 온라인 안심존 : 보안이 보장된 온라인 네트워크를 통해 집, 연구실, 사무실 등 어디서나 접속하여 데이터에 접근하고 분석

* 오프라인 안심존 : 추가적인 보안이 필요한 데이터를 대상으로 지정된 물리적 공간에서만 접속하여 데이터에 접근하고 분석 -

- AI 허브 접속

신청자 - 안심존

사용신청신청자신청서류 제출* - 심사구축기관

- 승인구축기관

- 데이터 분석 활용신청자

- 분석모델반출신청자

- AI 허브 접속

-

1. 기관생명윤리위원회(IRB) 심의 결과 통지서 [IRB 알아보기] [공용IRB 심의신청 가이드라인]

2. 기관생명윤리위원회(IRB) 승인된 연구계획서

3. 신청자 소속 증빙 서류 (재직증명서, 재학증명서, 근로계약서 등 택1)

4. 안심존 이용 신청서 [다운로드]

5. 보안서약서 [다운로드]

※ 상기 신청서 및 첨부 서류를 완비한 후 신청을 진행하셔야 정상적으로 절차가 이루어집니다. -

신청 및 이용관련 문의는 safezone1@aihub.kr 또는 02-525-7708, 7709로 문의

데이터셋 다운로드 승인이 완료 된 후 API 다운로드 서비스를 이용하실 수 있습니다.

API 다운로드 파일은 분할 압축되어 다운로드 됩니다. 분할 압축 해제를 위해서는 분할 압축 파일들의 병합이 필요하며 리눅스 명령어 사용이 필요합니다.

리눅스 OS 계열에서 다운로드 받으시길 권장하며 윈도우에서 파일 다운로드 시 wsl(리눅스용 윈도우 하위 시스템) 설치가 필요합니다.

※ 파일 병합 리눅스 명령어

find "폴더경로" -name "파일명.zip.part*" -print0 | sort -zt'.' -k2V | xargs -0 cat > "파일명.zip"

- 해당 명령어 실행 시, 실행 경로 위치에 병합 압축 파일이 생성됩니다.

- 병합된 파일 용량이 0일 경우, 제대로 병합이 되지 않은 상태이니 "폴더경로"가 제대로 입력되었는지 확인 부탁드립니다.

※ 데이터셋 소개 페이지에서 다운로드 버튼 클릭하여 승인이 필요합니다.

오프라인 데이터 이용 안내

본 데이터는 K-ICT 빅데이터센터에서도 이용하실 수 있습니다.

다양한 데이터(미개방 데이터 포함)를 분석할 수 있는 오프라인 분석공간을 제공하고 있습니다.

데이터 안심구역 이용절차 및 신청은 K-ICT빅데이터센터 홈페이지를 참고하시기 바랍니다.

국방데이터 개방 안내

본 데이터는 국방데이터로 군사 보안에 따라 AI허브에서 데이터를 제공하지 않으며,

군 담당자를 통한 별도의 사용 신청이 필요합니다.